Unitree B2-W(車輪付き四脚ロボット)はメーカー提供の歩行ポリシーでは不整地に対応できません。本プロジェクトでは、NVIDIA Isaac Sim上で強化学習(PPO)を用いて不整地歩行ポリシーを新たに学習。2,048並列環境でのカリキュラム学習により、階段・坂道・凹凸地形を自律走破する16自由度の制御ポリシーを獲得しました。

「歩けないロボット」を「不整地を自律走破するロボット」に変える

学習済みポリシーによる不整地走破デモ — 凹凸地形をカメラ追従で撮影

Unitree B2-Wは車輪+脚のハイブリッド四脚ロボットです。メーカーからは平地向けの歩行ポリシーが提供されていますが、**不整地(階段・坂道・凹凸地形)に対応した歩行ポリシーは提供されていません。** ホイールだけで段差に突っ込んでも越えられない——脚と車輪の16自由度を協調させる制御が必要です。

本プロジェクトでは、NVIDIA Isaac Sim上で強化学習(PPO)を用いて不整地歩行ポリシーを新たに学習し、モデルを生成しました。転倒するだけだったロボットが、約8時間の学習で階段・坂道・凹凸地形を自律走破できるようになっています。

対象ロボット

なぜ強化学習で新たに学習する必要があるのか

メーカー提供のポリシーは平地での移動に最適化されており、不整地には対応していません。ホイールだけでは段差を越えられず、脚だけでは平地で遅い。「いつ脚を使い、いつ車輪を使うか」を地形に応じてリアルタイムに判断する制御が求められます。

この判断を人手でプログラムするのは現実的ではありません。地形の種類は無限にあり、ルールの組み合わせが爆発するためです。強化学習なら、シミュレーション上で2,048体のロボットに数千パターンの地形を同時に体験させ、最適な脚・車輪協調制御を自動で獲得できます。

学習の進行 — 転倒から自律歩行へ

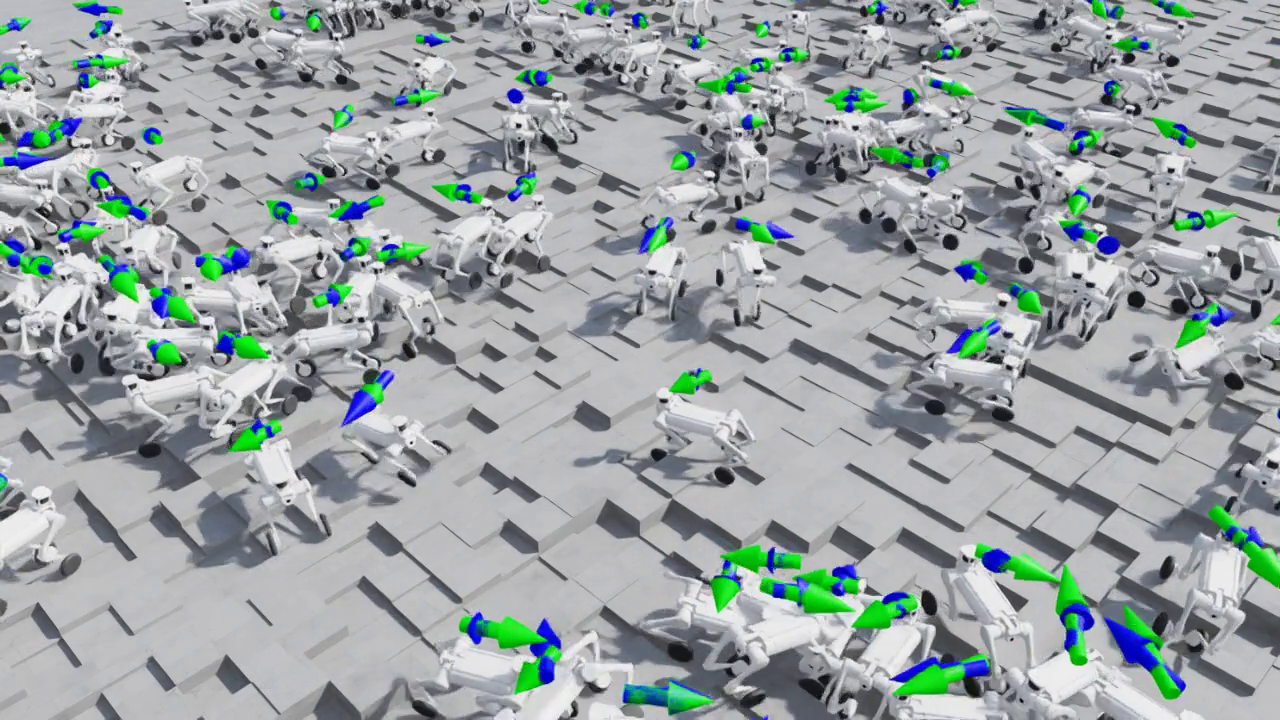

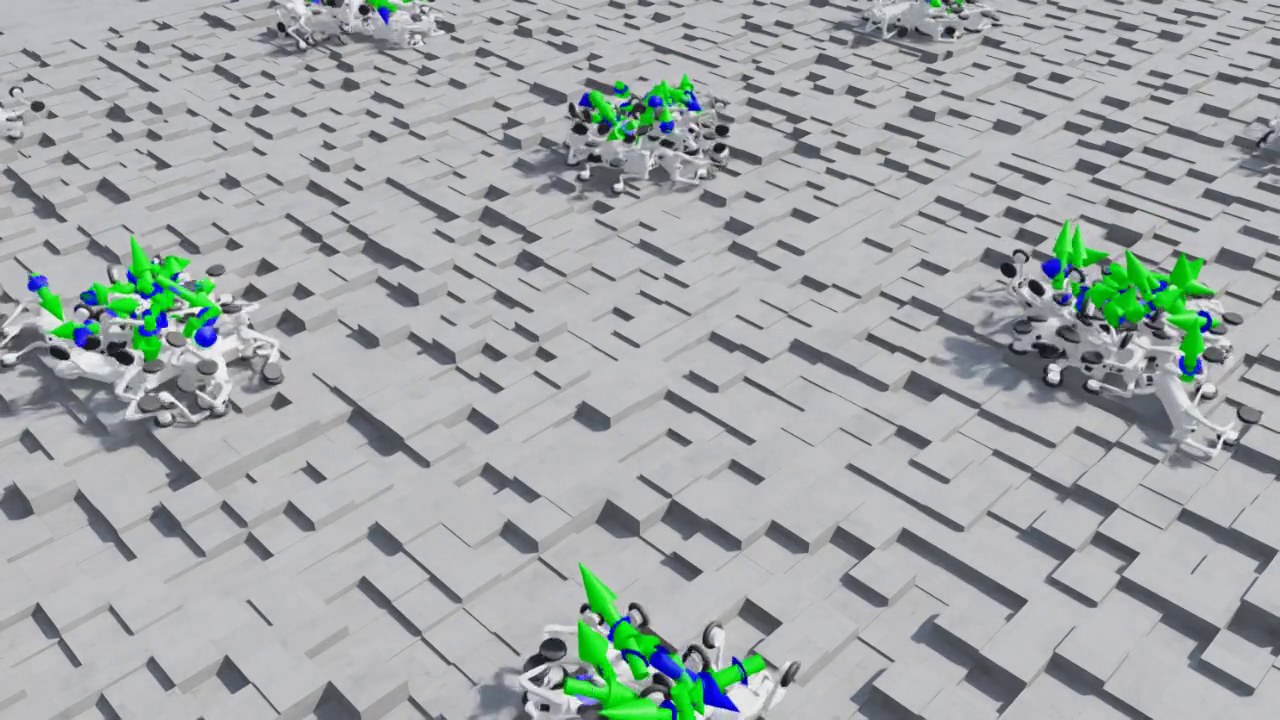

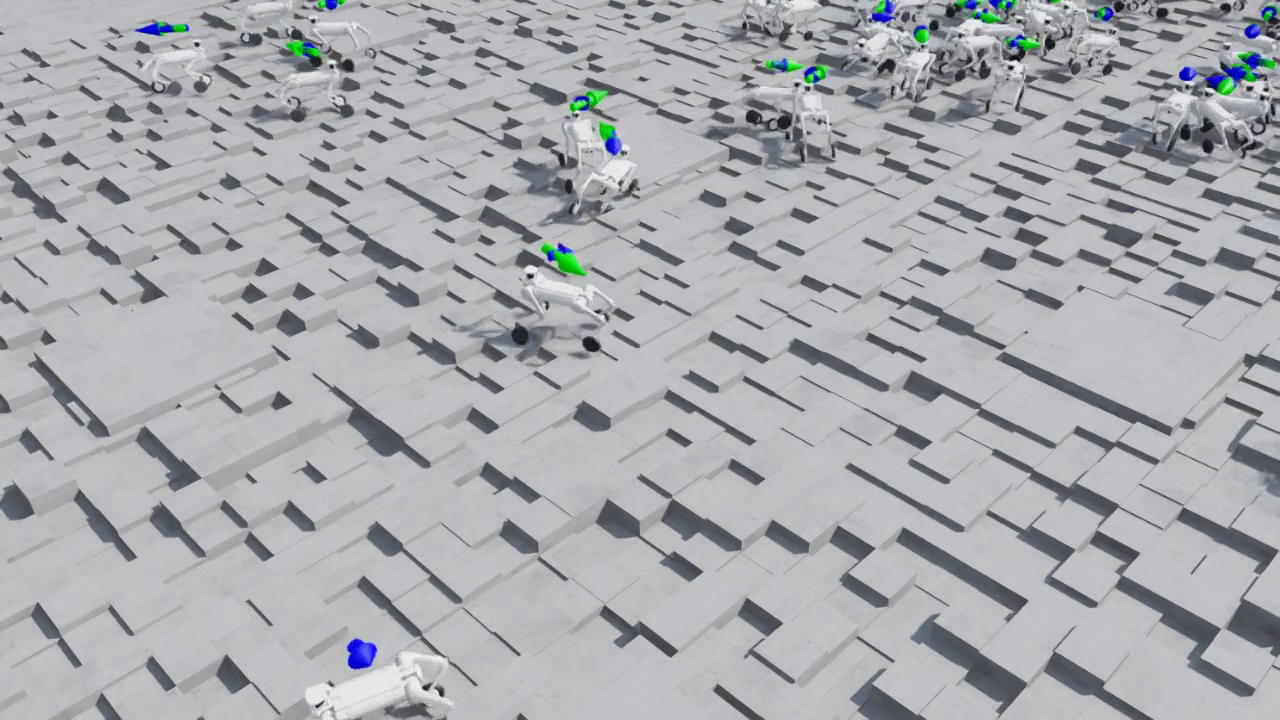

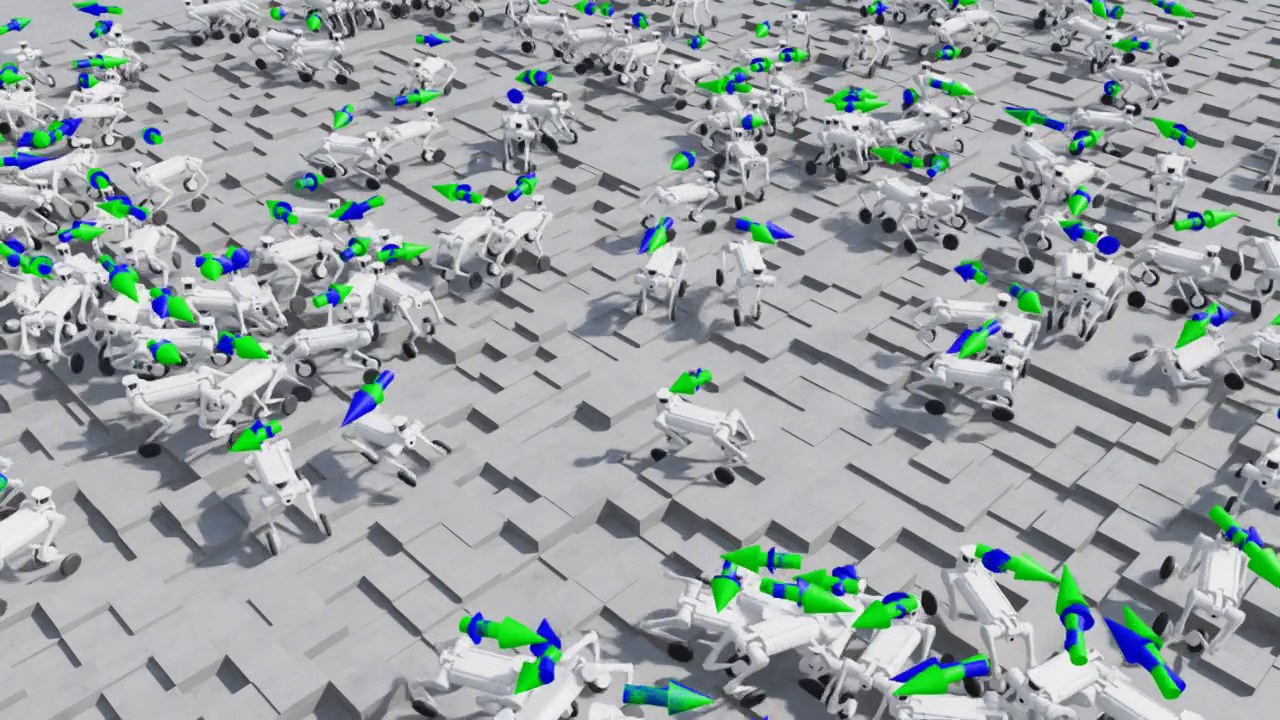

2,048体のロボットを同時にシミュレーションし、不整地上で試行錯誤を繰り返すことで、ポリシーが段階的に進化します。

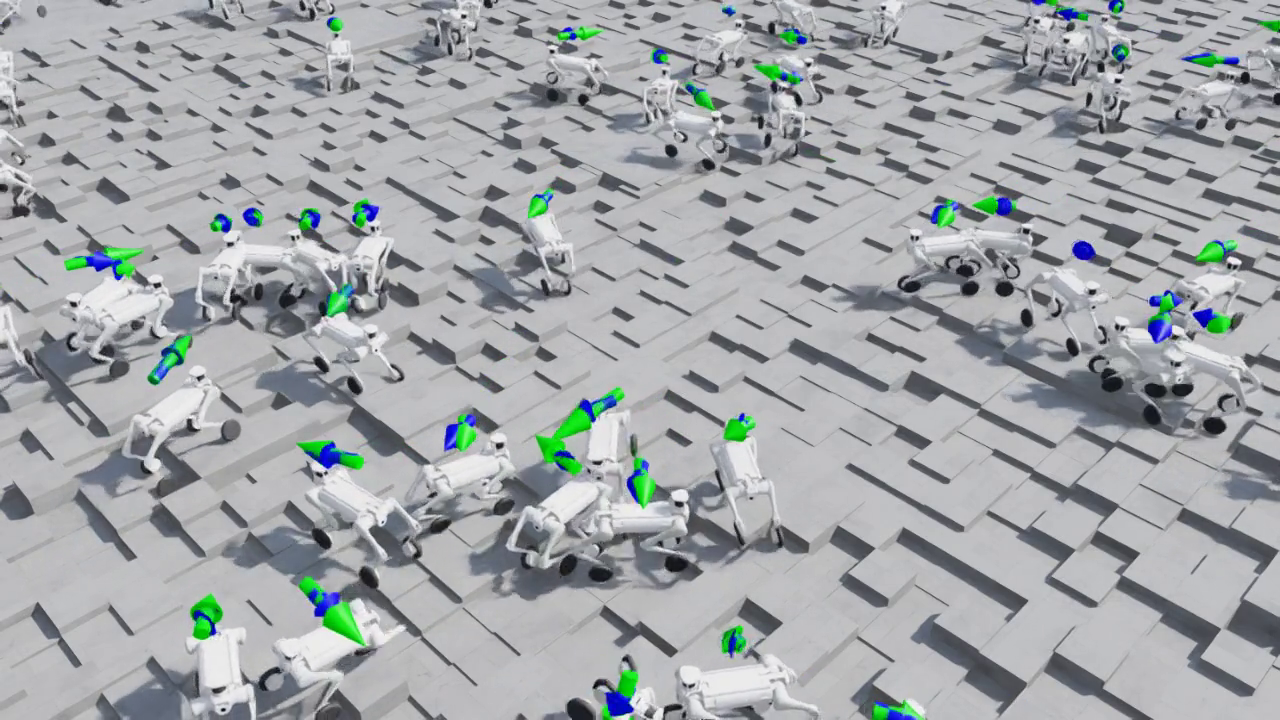

学習初期 — ロボットが転倒し歩行できない

学習完了 — 不整地を安定して走破

技術スタック

成果

報酬設計のブレイクスルー — 7回の失敗を経て

報酬設計を7回イテレーション(v2〜v7)した結果、初期の設計では「立つが前進しない」局所解に陥ることが判明しました。体高ペナルティの過剰付与、脚と車輪の未分離、転倒即終了の設計が根本原因でした。

以下の設計変更で局所解を突破し、不整地走破ポリシーの獲得に成功しています。

Sim-to-Real — 実機への展開

学習済みポリシーはONNX形式で出力されるため、実機のエッジコンピュータに直接デプロイ可能です。Blind Policy設計により、シミュレーションと実機のセンサ差(Sim-to-Realギャップ)を最小化しています。

こんな課題をお持ちの方へ

学習の進行過程

シミュレーション内の2,048体のロボットが、試行錯誤を通じて歩行を獲得していく様子

学習開始直後 — ロボットが転倒し、まだ歩行できない状態

学習初期 — 一部のロボットが立ち上がり始める

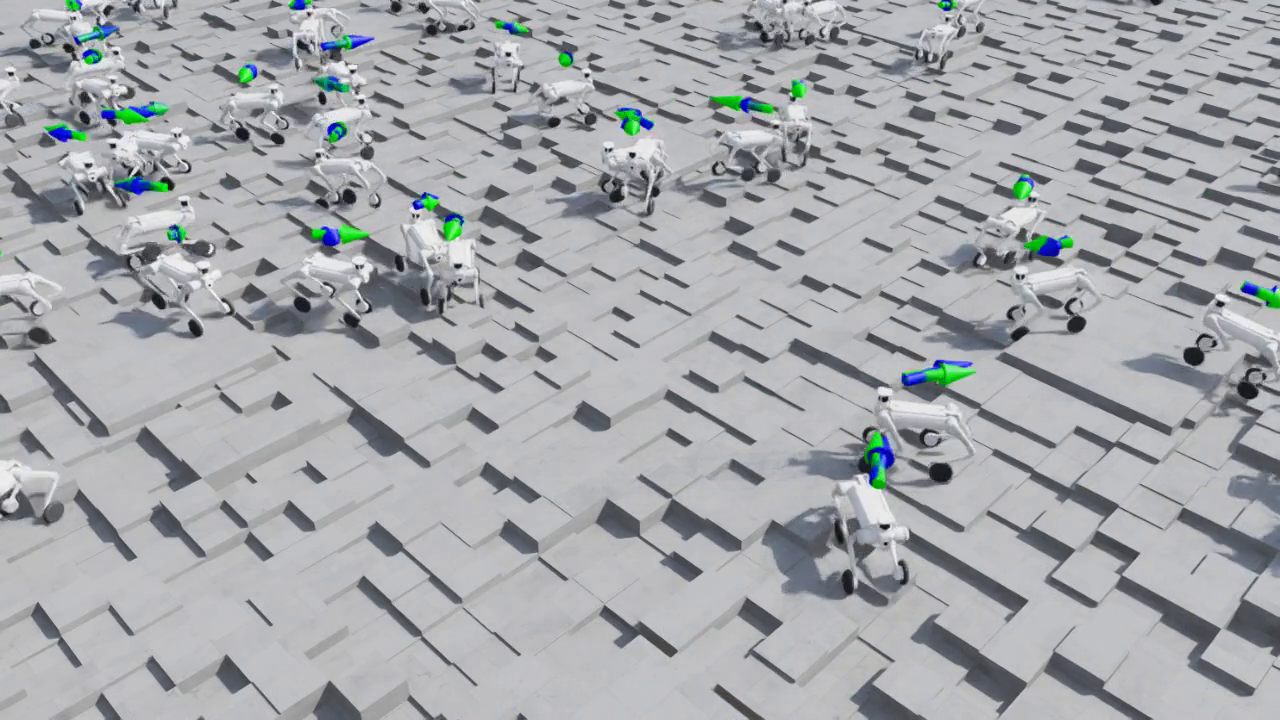

学習中盤 — 多数のロボットが不整地上で歩行を開始

学習後半 — より難しい地形にも適応し始める

学習完了間近 — 安定した歩行ポリシーを獲得